【超初心者向け】PyTorchのチュートリアルを読み解く。<その4>

本シリーズでは,ディープラーニングを実装する際に強力な手助けをしてくれる「PyTorch」についてです。公式チュートリアルを,初心者に向けてかみ砕きながら翻訳していこうと思います。(公式ページはこちらより)

今回はNo.4で,「分類器の学習」編です。その他の記事は,こちらの「PyTorchの公式チュートリアルを初心者向けに読み解く」をご覧ください。

読みたい場所へジャンプ!

データセット

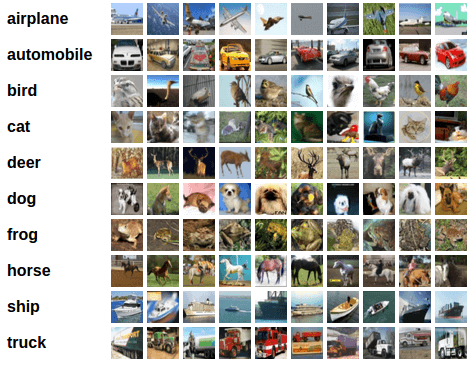

CIFAR-10を利用します。CIFAR-10は,画像の分類タスクのための有名なデータセットです。

出典:https://pytorch.org/tutorials/beginner/blitz/cifar10_tutorial.html#sphx-glr-beginner-blitz-cifar10-tutorial-py

出典:https://pytorch.org/tutorials/beginner/blitz/cifar10_tutorial.html#sphx-glr-beginner-blitz-cifar10-tutorial-py

分類器の学習の流れ

1.データセットのロードと正規化

2.ニューラルネットワークの定義

3.損失関数の定義

4.訓練データ上でネットワークの学習

5.テストデータ上でネットワークのテスト

必要なライブラリ等のインポート

import torch

import torchvision

import torchvision.transforms as transforms

import matplotlib.pyplot as plt

import numpy as np

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optimtorchvisionはPyTorchのデータロードなどに関するパッケージです。transformsはその中でも下処理に特化したものです。torch.nnとoptimはモデルの定義で使用します。

データセットのロードと正規化

transform = transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.5, 0.5, 0.5), (0.5, 0.5, 0.5))])

trainset = torchvision.datasets.CIFAR10(root='./data', train=True,

download=True, transform=transform)

trainloader = torch.utils.data.DataLoader(trainset, batch_size=4,

shuffle=True, num_workers=2)

testset = torchvision.datasets.CIFAR10(root='./data', train=False,

download=True, transform=transform)

testloader = torch.utils.data.DataLoader(testset, batch_size=4,

shuffle=False, num_workers=2)

classes = ('plane', 'car', 'bird', 'cat',

'deer', 'dog', 'frog', 'horse', 'ship', 'truck')transforms.Compose()でデータの下処理に使用する関数を定義していきます。中身(引数)をみてみると,「ToTensor」と「Normalize」で構成されていることが分かります。前者は,データをPyTorchで扱えるテンソルに変換します。後者は,データを正規化します。引数を確認すれば,(R, G, B)に関して平均(0.5, 0.5, 0.5),標準偏差(0.5, 0.5, 0.5)と設定していることが分かります。

Compose()以降では,データセットとデータローダーを定義しています。データセットはCIFAR10を指定し,「ダウンロード先は”./data”」「train=で訓練用かテスト用かを指定」「download=でダウンロードを実行するか指定」「transformで正規化の規則を指定」しています。データローダーでは「読込先のデータセット」「バッチサイズ」「シャッフルするか」「使用するコアの数」を指定します。最後に,クラス名を配列として定義しておきます。

データセットの確認

def imshow(img):

img = img / 2 + 0.5 # unnormalize

npimg = img.numpy()

plt.imshow(np.transpose(npimg, (1, 2, 0)))

dataiter = iter(trainloader)

images, labels = dataiter.next()

imshow(torchvision.utils.make_grid(images))

print(' '.join('%5s' % classes[labels[j]] for j in range(4)))out:

car deer cat bird

imshow()は,plt.imshowの入力の範囲[0,1]にフィットするように修正してから画像を出力する関数です。np.transpose(npimg, (1, 2, 0))では(RGB, 縦, 横)を(縦, 横, RGB)に変えています。

iter()では,訓練データを繰り返し取り出せるようにイテレーターに変換しています。ここで新たにイテレーターを定義する理由としては,バッチサイズ (今回は4)ごとに繰り返したいからです。

とりあえず,imagesとlabelsをイテレータの最初の塊として指定して可視化します。make_gridは画像を横に並べて表示します。「’%5s’ %…」ではラベル名を右寄せで5文字分表示するように設定しています。

ニューラルネットワークの定義

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = self.pool(F.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

net = Net()第三回「ニューラルネットワーク」でも学んだように,ネットワークをクラスで定義していきます。ただし,ニューラルネットワークとは異なり,max poolingをコンストラクタ(__init__)で定義してしまっています。そうすることで,forwardの表記が簡潔になっていますね。

損失関数の定義

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9)損失関数はクロスエントロピーで定義しています。アルゴリズムはSGD(確率的勾配降下法)を指定しています。引数としては,「net.parameters」で学習可能なパラメータを指定しています。lrは学習率,momentumはSGDに慣性項を加えることを指定しています。0.9は慣性項の係数です。

訓練データ上でネットワークの学習

for epoch in range(2):

running_loss = 0.0

for i, data in enumerate(trainloader, 0):

inputs, labels = data

optimizer.zero_grad()

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

running_loss += loss.item()

if i % 2000 == 1999:

print('[%d, %5d] loss: %.3f' %

(epoch + 1, i + 1, running_loss / 2000))

running_loss = 0.0

print('Finished Training')out:

[1, 2000] loss: 2.222

[1, 4000] loss: 1.902

[1, 6000] loss: 1.690

[1, 8000] loss: 1.588

[1, 10000] loss: 1.512

[1, 12000] loss: 1.489

[2, 2000] loss: 1.424

[2, 4000] loss: 1.411

[2, 6000] loss: 1.349

[2, 8000] loss: 1.349

[2, 10000] loss: 1.334

[2, 12000] loss: 1.312

Finished Training最初に訓練データセットtrainloaderにインデックスを付与してiとするために「enumerate」を利用しています。trainloaderにはimagesとlabelsが含まれていますので,それぞれinputsとlabelsとして定義しています。

以下は,第三回「ニューラルネットワーク」と同じ流れです。勾配を0で初期化,ネットワークに通す,ロスの計算,バックワードの実行(勾配の計算)とバックプロップの実行(パラメータの更新)です。running_lossでは,2000ミニバッチごとにロスを小数点三位まで表示するようにしています。

テストデータ上でネットワークのテスト

まずは,テストデータの確認をしてみます。コードは先ほどと全く一緒です。

dataiter = iter(testloader)

images, labels = dataiter.next()

imshow(torchvision.utils.make_grid(images))

print('GroundTruth: ', ' '.join('%5s' % classes[labels[j]] for j in range(4)))out:

GroundTruth: cat ship ship plane

outputs = net(images)

_, predicted = torch.max(outputs, 1)

print('Predicted: ', ' '.join('%5s' % classes[predicted[j]]

for j in range(4)))out:

Predicted: ship ship ship ship実際にネットワークに通して得られたoutputsから,推定された結果を表示しています。今回は全部shipとして推定されてしまいましたが,半分は当たっていますね。ちなみに,「_」というのは慣例的に使わない変数のことを指します。torch.maxの返り値は0番目にデータそのものを含みますので,「_」として指定しています。

この推定を,テストデータセット全てに適用してみましょう。

correct = 0

total = 0

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))out:

Accuracy of the network on the 10000 test images: 50 %

with torch.no_grad()内のブロックで実行することにより,勾配を記憶せずに計算を行うためメモリの節約に繋がります。精度は50%という結果でした。

さらに,クラスごとに精度を確認してみましょう。

class_correct = list(0. for i in range(10))

class_total = list(0. for i in range(10))

with torch.no_grad():

for data in testloader:

images, labels = data

outputs = net(images)

_, predicted = torch.max(outputs, 1)

c = (predicted == labels).squeeze()

for i in range(4):

label = labels[i]

class_correct[label] += c[i].item()

class_total[label] += 1

for i in range(10):

print('Accuracy of %5s : %2d %%' % (

classes[i], 100 * class_correct[i] / class_total[i]))out:

Accuracy of plane : 52 %

Accuracy of car : 68 %

Accuracy of bird : 40 %

Accuracy of cat : 18 %

Accuracy of deer : 41 %

Accuracy of dog : 40 %

Accuracy of frog : 65 %

Accuracy of horse : 61 %

Accuracy of ship : 89 %

Accuracy of truck : 30 %先ほどshipがたくさん出てきたことからも想像できるように,この分類器はshipの分類が得意なようです。一方,catの分類は18%とかなり精度が低いことが読み取れます。

GPU上で計算する

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

net.to(device)

inputs, labels = data[0].to(device), data[1].to(device)このようにして,「device」を定義した後に,「.to(device)」を利用してGPUに値を渡してあげます。このようにして,GPU上で計算を実行することができます。